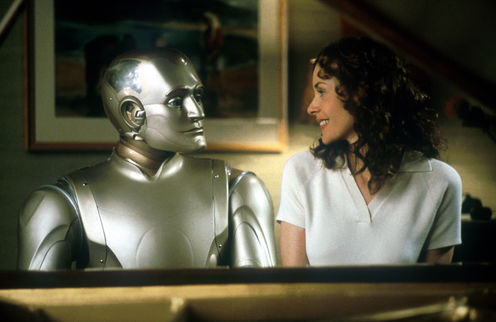

科幻小说喜欢描绘机器人作为独立的机器,能够做出自己的决定,经常表达自己的个性。然而我们也倾向于认为机器人是财产,和缺乏那种我们保留权利。

但是如果一台机器可以认为,决定和行动自己的意志,如果它可以受到伤害或对其行为负责,我们应该停止将它像财产并开始把它更像一个人的权利吗?

如果一个机器人实现真正的自我意识?它应该与我们平等的权利和保护法律,或者至少类似吗?

这些问题正在讨论由欧洲议会的法律事务委员会。去年,它发布了一个报告草案和运动要求一组民法规定机器人调节他们的制造、使用、自治和社会影响。

提出的法律解决方案,也许最有趣的是创建一个法律地位的建议“电子人”的最先进的机器人。

接近人格

该报告承认改进机器人的自主和认知能力让他们超过简单的工具,并使普通的责任规定,如合同和侵权责任,处理他们的不足。

例如,当前欧盟指令在损害责任由机器人仅覆盖可预见的制造缺陷造成的损害。在这些情况下,制造商负责。然而,当机器人能够学习和适应他们的环境,在不可预知的方式,它是制造商难以预见的问题,可能会造成伤害。

该报告还质疑是否足够复杂的机器人应当被视为自然人、法人(如企业),动物或物体。而不是把他们现有的类别,它提出一个新的类别的“电子人”更合适。

这份报告并没有主张立即采取立法行动,虽然。相反,它提出立法更新如果机器人变得更复杂;如果他们开发更多的行为复杂。如果发生这种情况,推荐的方法是减少“创造者”的责任比例的自治机器人,“无过错”责任强制保险可以填补资金缺口。

但是为什么走这么远来创建一个新的类别的“电子人”?毕竟,计算机仍然有很长一段路要走他们比赛前人类智慧,如果他们做的。

但是它可以同意机器人——或者更精确地控制他们的软件——正变得越来越复杂。自动(或“紧急”)的机器正变得越来越普遍。有正在进行的讨论法律责任的自主车辆,或者我们是否可以起诉机器人外科医生.

这些都不是很复杂的问题,只要责任取决于制造商。但是,如果制造商无法轻易识别比如,如果开源软件使用自动车辆?你苏当数以百万计的世界各地的“创造者”?

人工智能也开始履行其绰号。阿兰·图灵,提出了现代计算机之父测试计算机被认为是“智能”的人类如果傻瓜相信电脑是人类的反应问题。已经有机器接近通过这个测试。

塞拉利昂泥石流:至少600人失踪在弗里敦

图像版权路透图片标题山坡上许多房子倒塌大雨后摄政 至少有600人失踪后泥石流和洪水摧

便士响应特朗普的话:“我站在总统身边”

副总统便士周三表示,他在总统特朗普的批评下表示赞成,他的言论指责了在白俄罗斯的夏

布里吉特・Macron证实,“宪章”会澄清其作用透明度

布里吉特Macron采访中证实,它将在星期五杂志,它的作用将是非依据一项法律,而是章程,阐

夏洛特维尔受害者的妈妈到白人至上主义者:“你只是放大她的”

在星期三举行的仪式上,希瑟海耶(Heather Heyer)是一名32岁的受害者的母亲苏珊布罗

Nathan取缔最佳英国餐厅美食指南

康沃尔郡的海鲜餐馆已经加冕最好的在英国每年食物指南,肘击坎布里亚郡L Enclume后到了